"Öffentlichkeitskommunikation mit XR"

Fraunhofer IAO, 2023

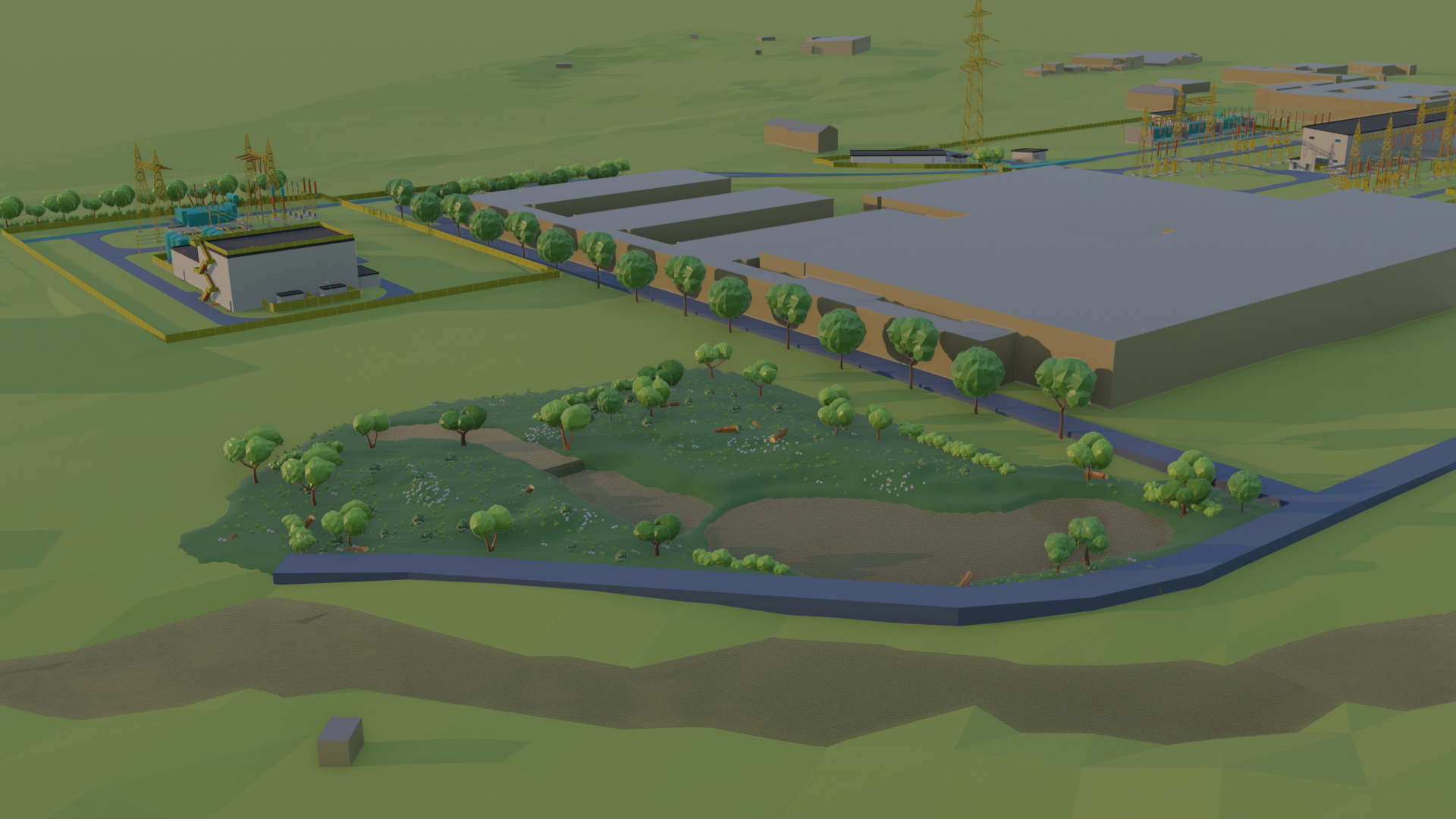

Projektvorhaben

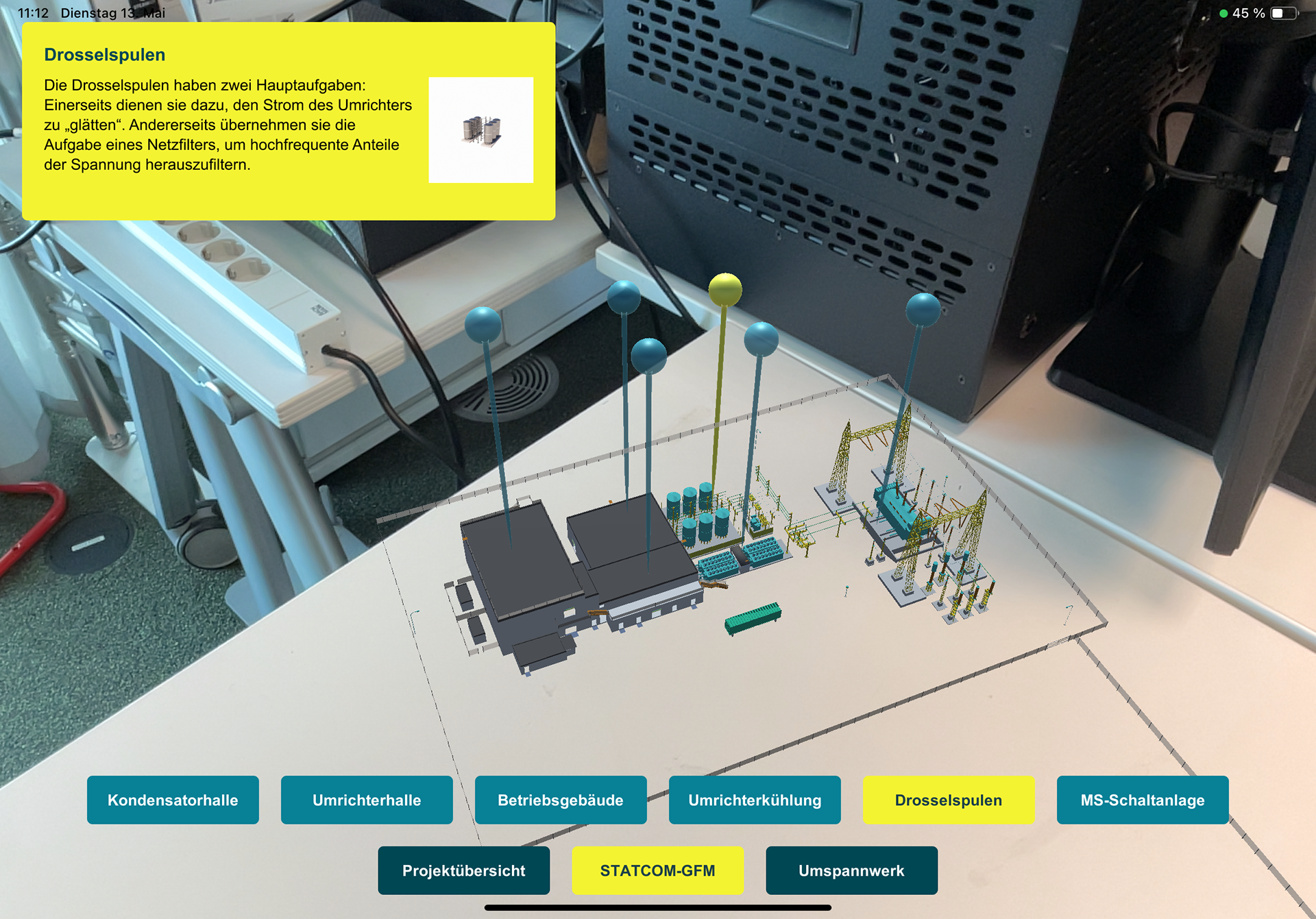

TransnetBW plant die Modernisierung, sowie den Umbau des bestehenden Umspannwerks Wendlingen. Diese Veränderungen sollen bei einem Bürgerinfomarkt durch den Einsatz von Augmented Reality kommuniziert werden.

Ziel

Augmented Reality App für iOS (iPad). Aufarbeitung von BIM und CAD Dateien. Erstellung eines Umgebungsmodells und Visualisierung der landschaftlichen Veränderung.

Meine Aufgaben

Die eigenständige Konzeption und Entwicklung der AR-App und Interaktion. Konfiguration von Profilen und Zertifikaten, sowie der Bereitstellung der App via TestFlight. Kommunikation und Planung mit dem Kunden.

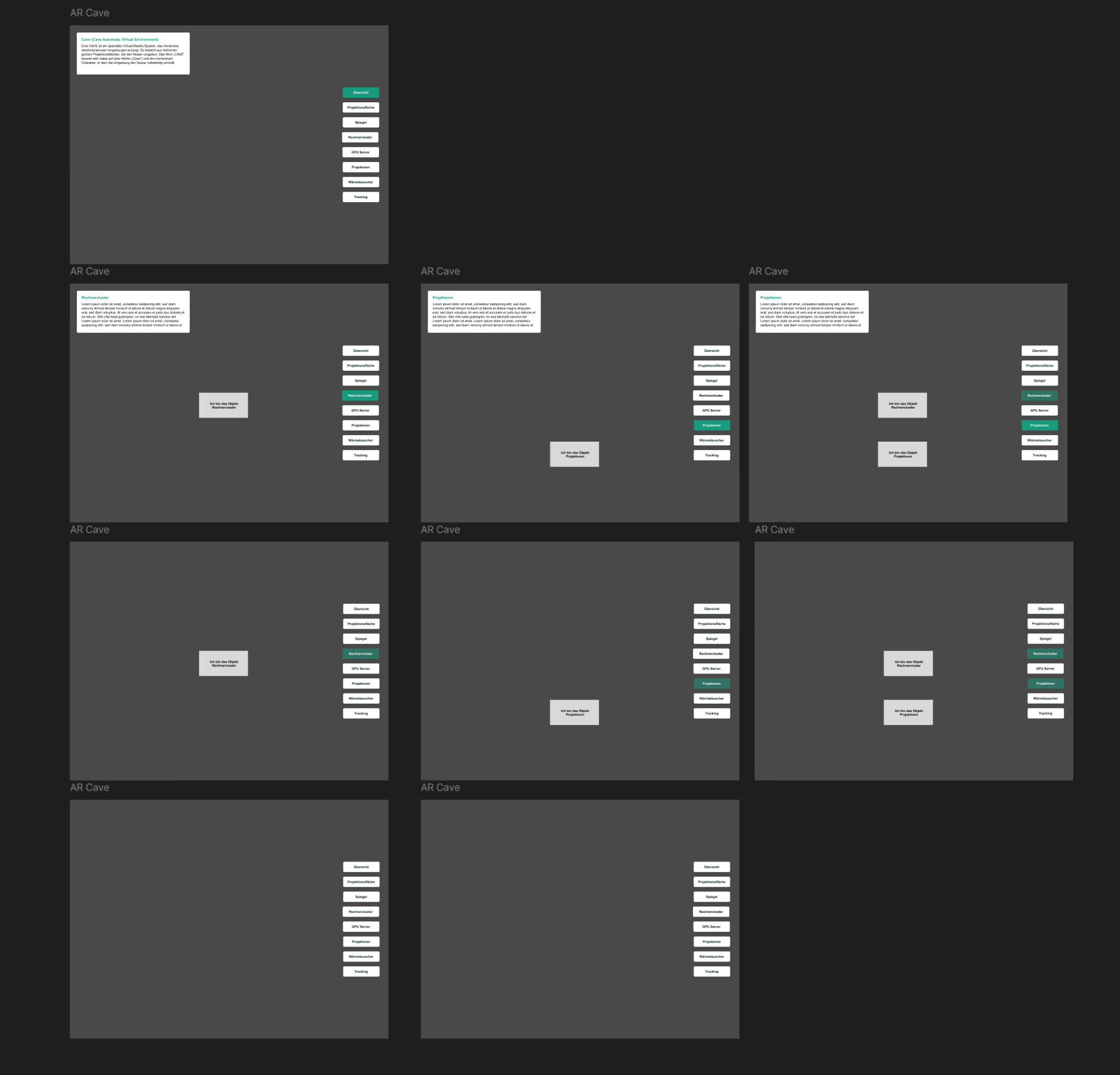

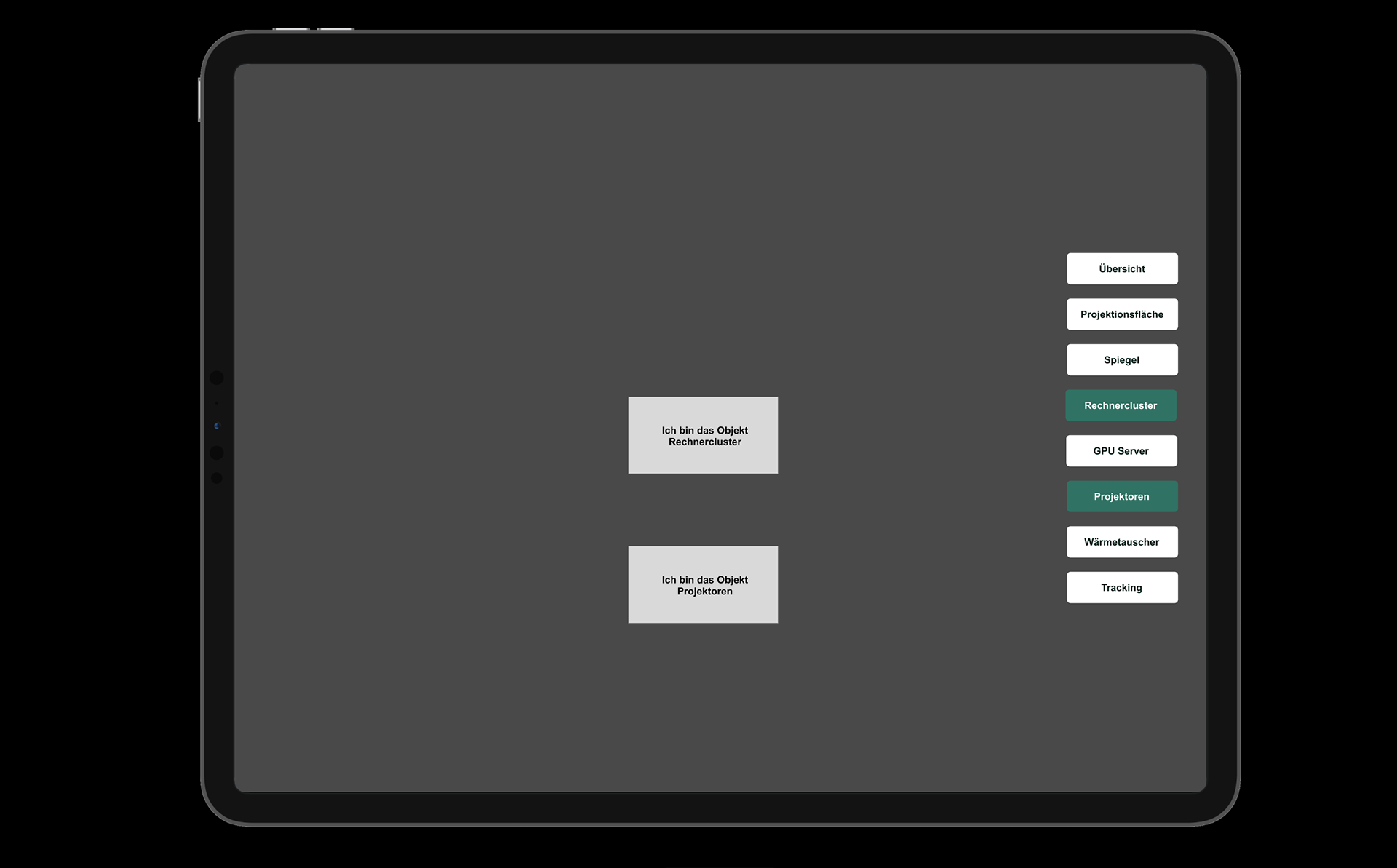

Screenshots aus der Konzeptionsphase in Figma.

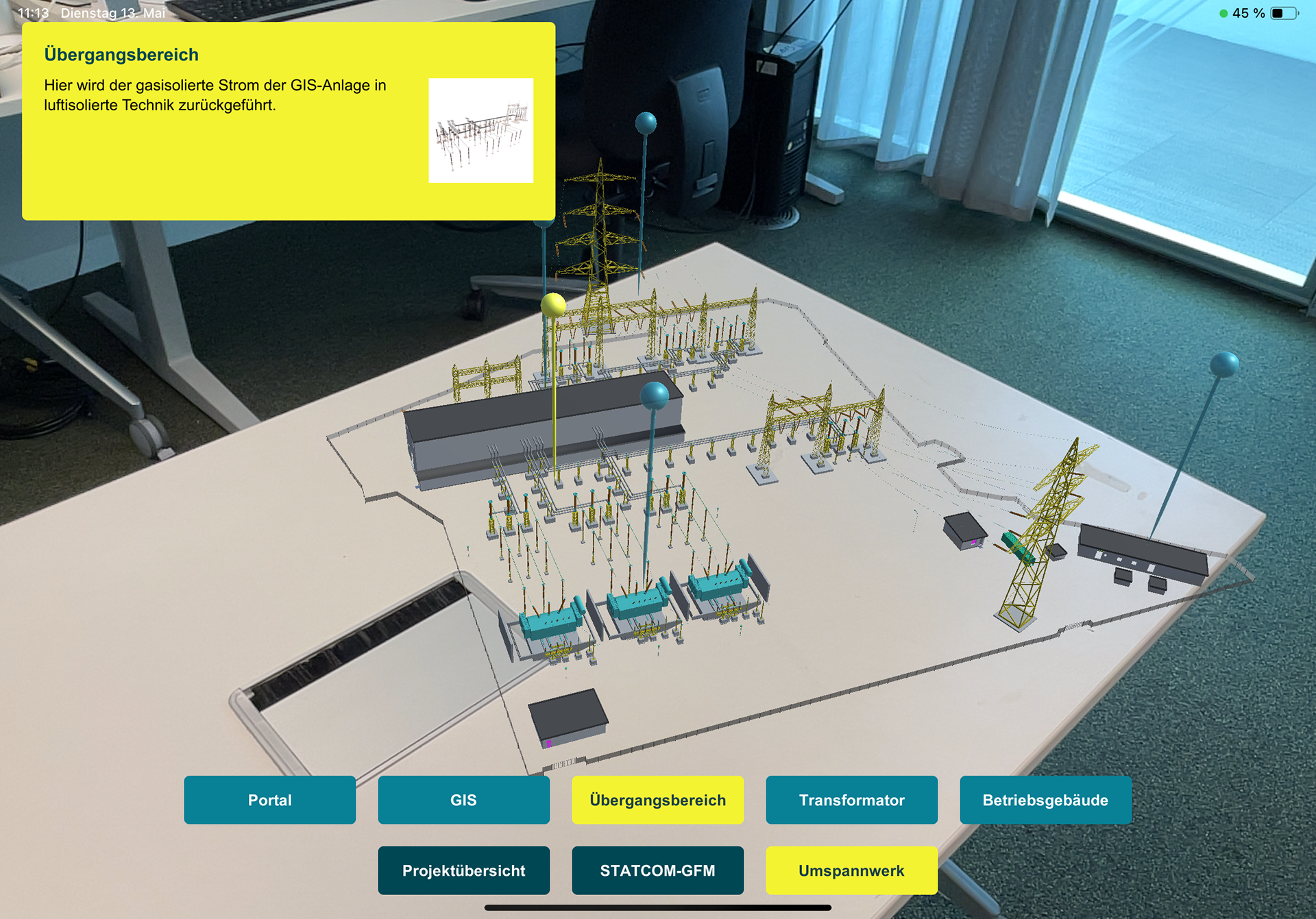

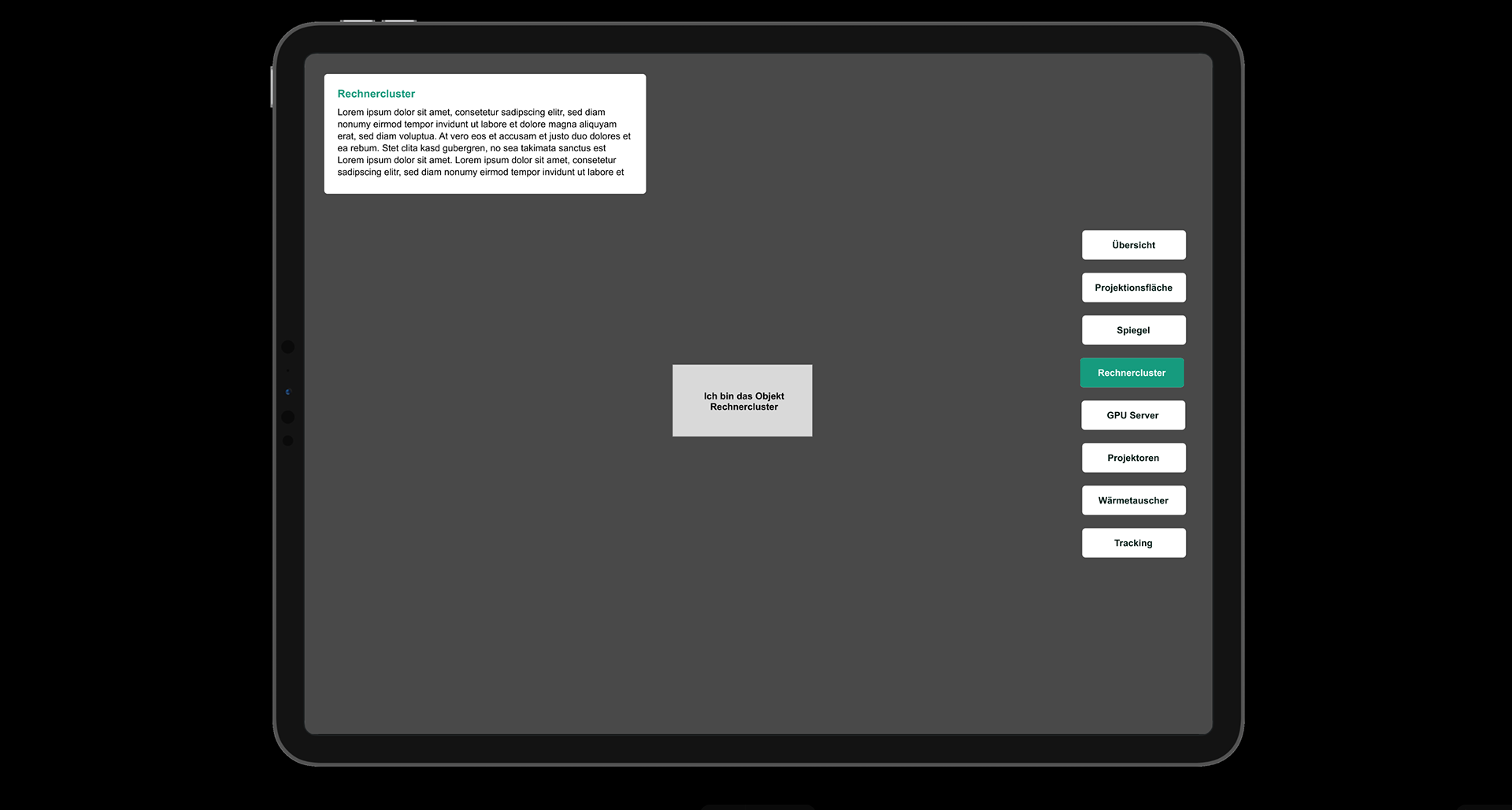

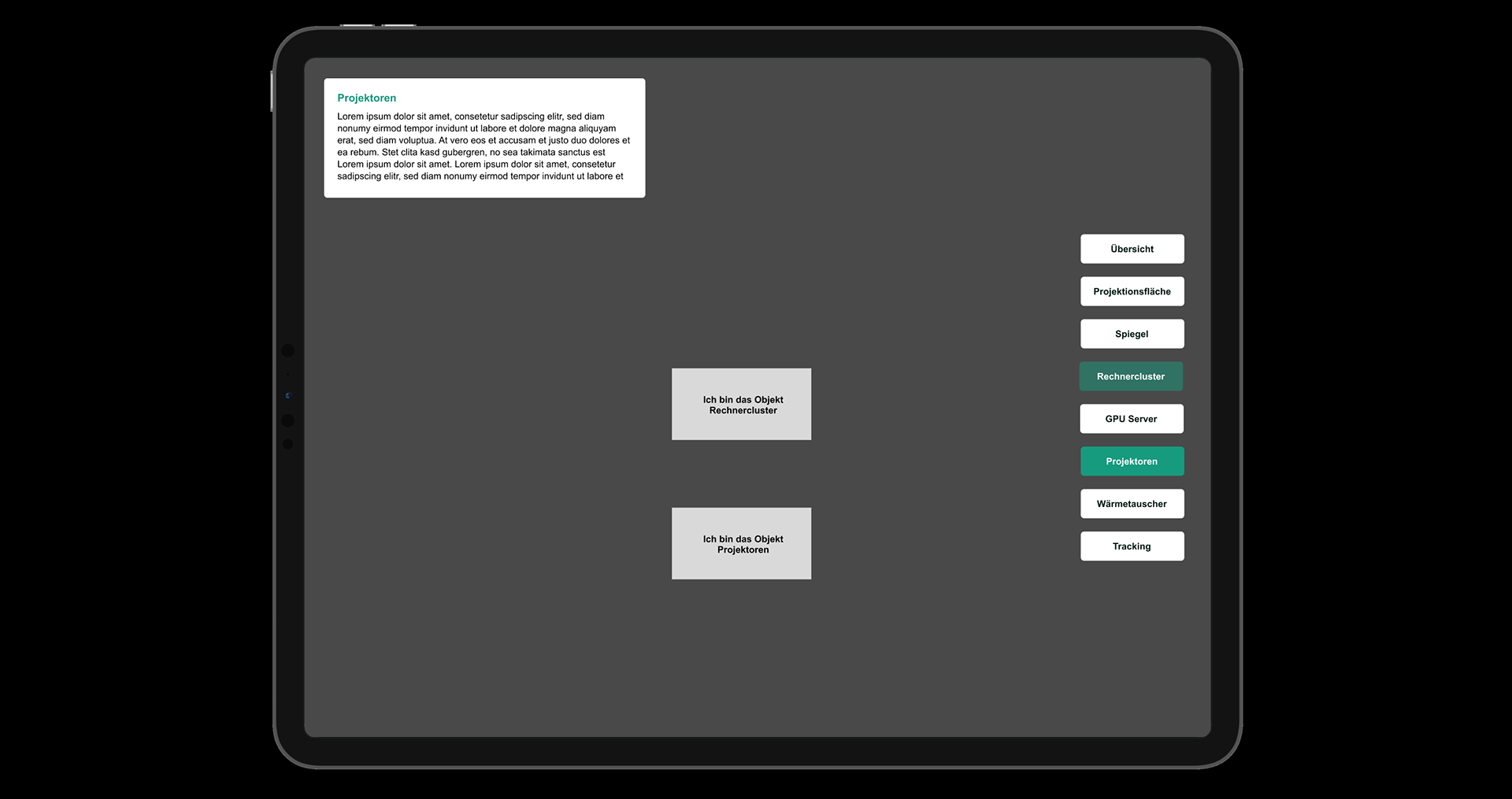

AR-Demonstrations-Anwendung "Cave"

Fraunhofer IAO, 2024

Projektvorhaben

Ausgangslage war die Renovierung der CAVE (Cave Automatic Virtual Environment) im Immersive Participation Lab des Fraunhofer IAO.

Die AR-App soll auf anschauliche Weise vermitteln, welche Veränderungen der Umbau mit sich bringt und welche neuen Features die einzelnen Komponenten bieten. Sie dient dazu, interne Teams, Partner sowie potenzielle Kunden bei der feierlichen Eröffnung zu informieren – und wird darüber hinaus als zukünftige Demo-App eingesetzt.

Die AR-App soll auf anschauliche Weise vermitteln, welche Veränderungen der Umbau mit sich bringt und welche neuen Features die einzelnen Komponenten bieten. Sie dient dazu, interne Teams, Partner sowie potenzielle Kunden bei der feierlichen Eröffnung zu informieren – und wird darüber hinaus als zukünftige Demo-App eingesetzt.

Ziel

Augmented Reality App für iOS (iPad).

Meine Aufgaben

Die eigenständige Planung, Konzeption und Entwicklung der AR-App und Interaktion.

AR App bei der Eröffnungsfeier des Immersive Participation Lab, Fraunhofer IAO.

XR-Demonstrationsanwendungen für die Varjo XR-3

Fraunhofer IAO, 2025

Ausgangslage

Bereits 2021 habe ich eine experimentelle Demo-App für die Varjo XR-1 entwickelt, die UI-Interaktionen über Eyetracking ermöglichte. Diese Demo sollte nun grundlegend überarbeitet und zu einer mehrteiligen Anwendung für die Varjo XR-3 weiterentwickelt werden.

Ziel

Ziel war die Entwicklung einer modularen Demo-Anwendung, mit der sich die verschiedenen Features der Varjo XR-3 praxisnah erproben und demonstrieren lassen.

Meine Aufgaben

Meine Aufgaben umfassten die Konzeption, die Planung sowie die vollständige Entwicklung und Dokumentation der Anwendung. Dabei habe ich mehrere eigenständige Module umgesetzt, die unterschiedliche Schwerpunkte aufzeigen und in Summe die Bandbreite der Varjo XR-3 abbilden.

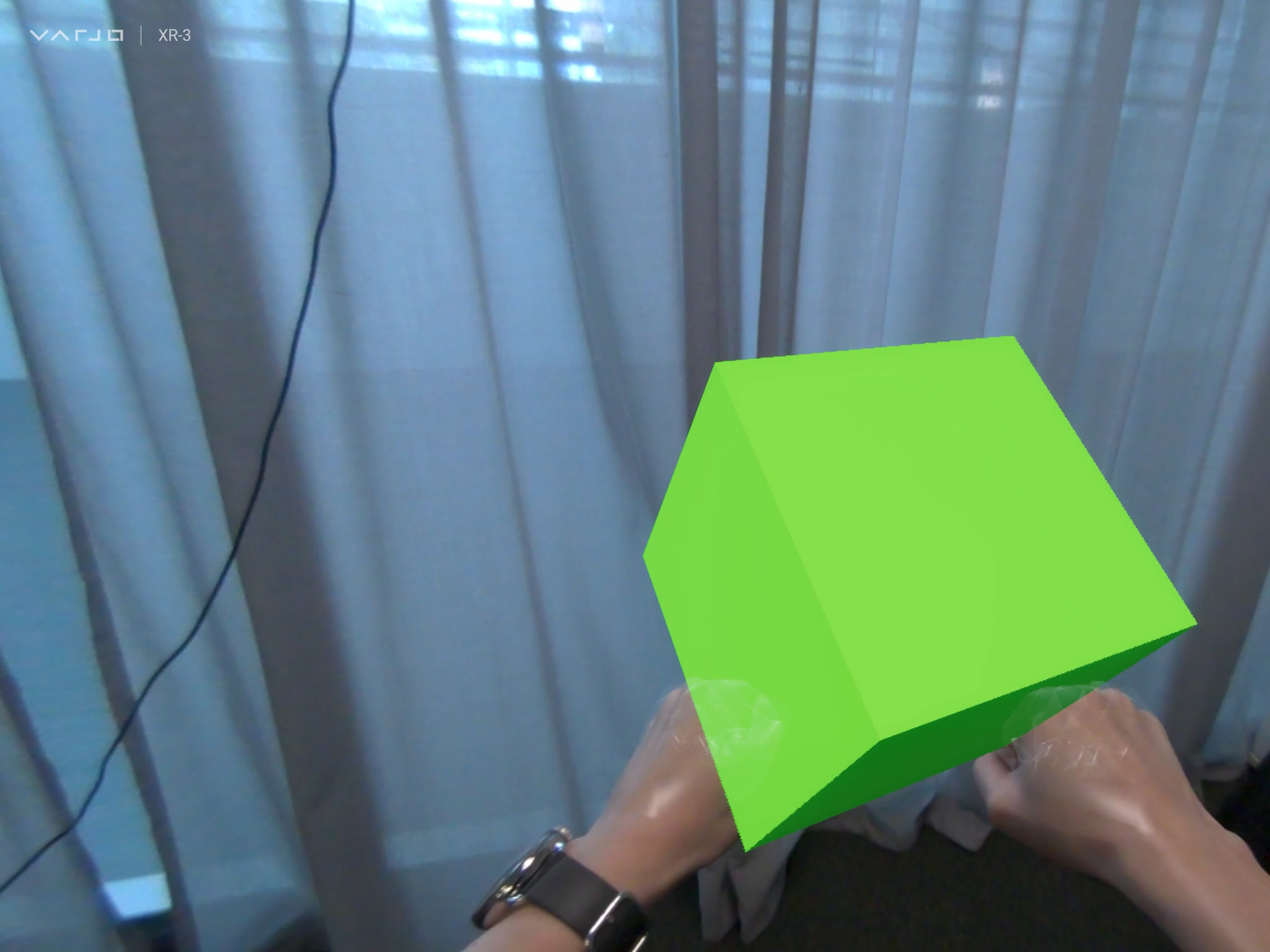

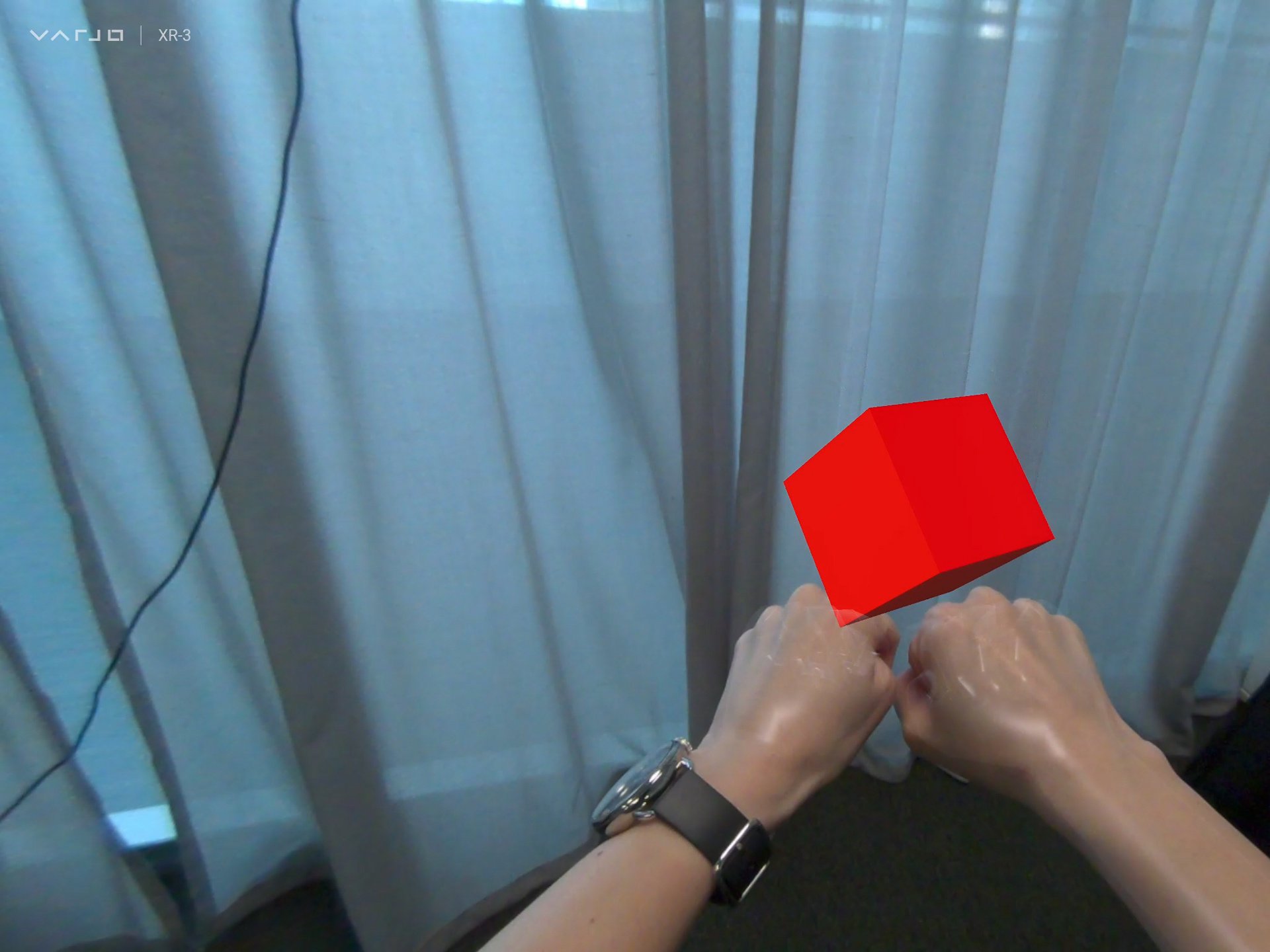

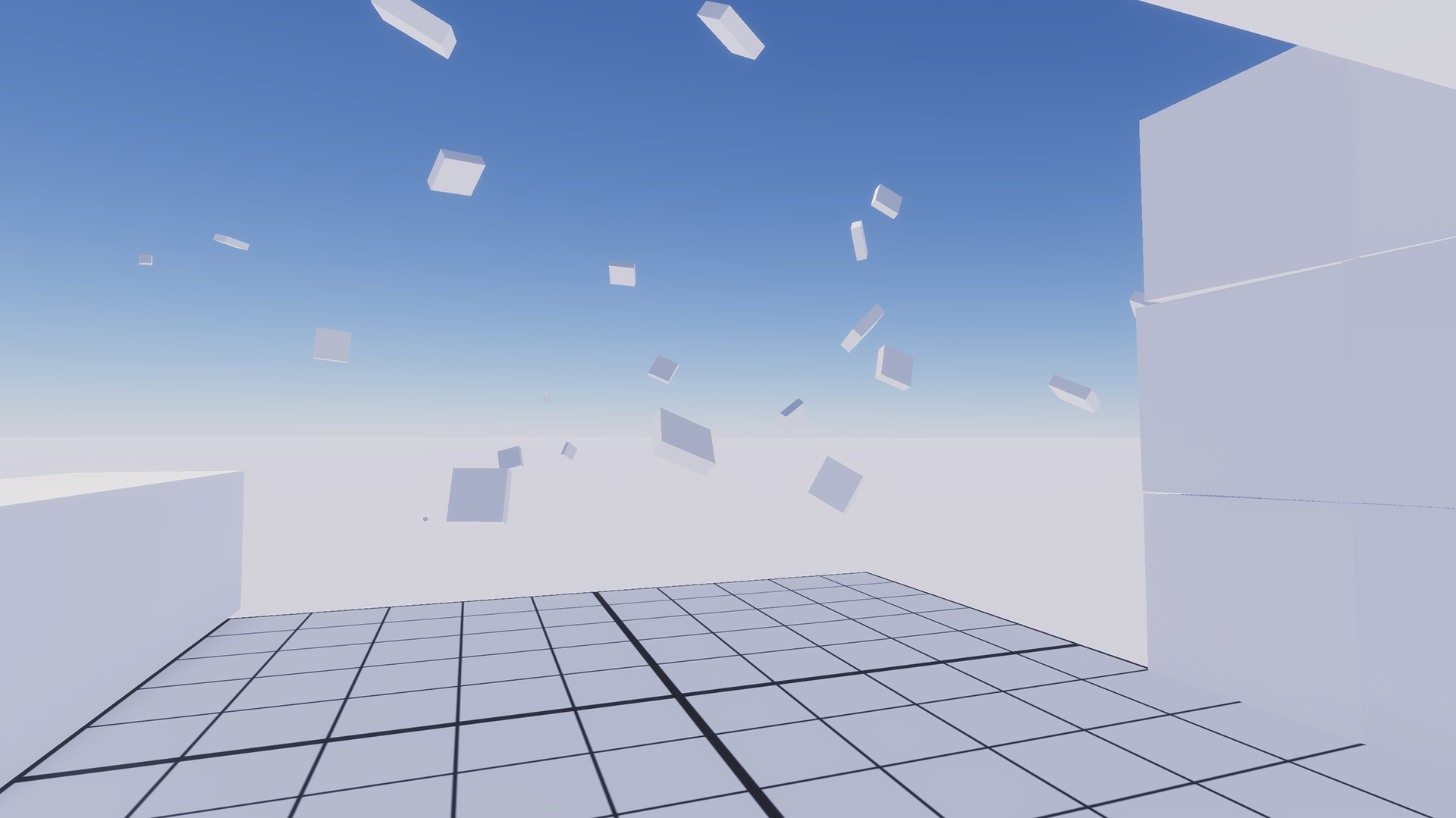

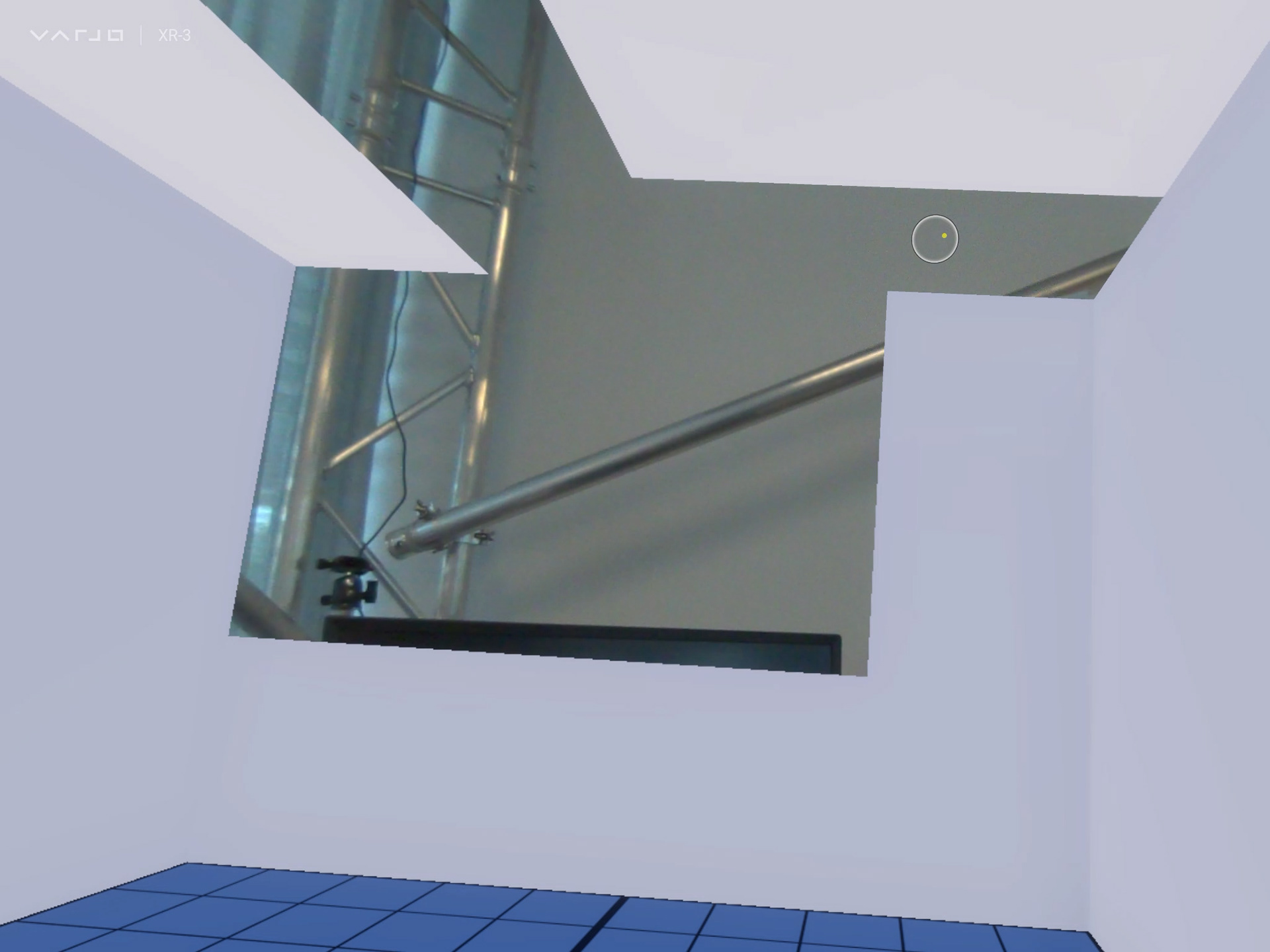

1. Modul: Fokus auf Handtracking in Kombination mit Mixed Reality.

Hierbei konnten Nutzer*innen das User Interface direkt mit ihren Händen bedienen, ohne zusätzliche Controller. Parallel wurde die Qualität des Passthrough-Modus demonstriert. Ergänzt wurde dieses Szenario durch ein Marker-getracktes 3D-Scan-Modell, an dem exemplarisch verschiedene UI-Elemente verankert werden konnten, um mögliche Use Cases im Bereich Mixed-Reality-Anwendungen greifbar zu machen.

Ausschnitte aus der Anwendung des ersten Moduls: Man sieht die 3D-Objektskalierung. Über die Grab-Funktion wird in diesem Beispiel der Würfel ausgewählt. Dieser färbt sich grün, um anzuzeigen, dass er nun skaliert werden kann. Der Abstand zwischen den Händen wird gemessen und kontinuierlich getrackt, wodurch der Würfel in seiner Größe verändert werden kann. Zusätzlich besitzt er zwei feste Endgrößen, „klein“ und „groß“. Er färbt sich rot, um den Nutzenden darauf hinzuweisen, dass eine dieser Grenzen erreicht wurde.

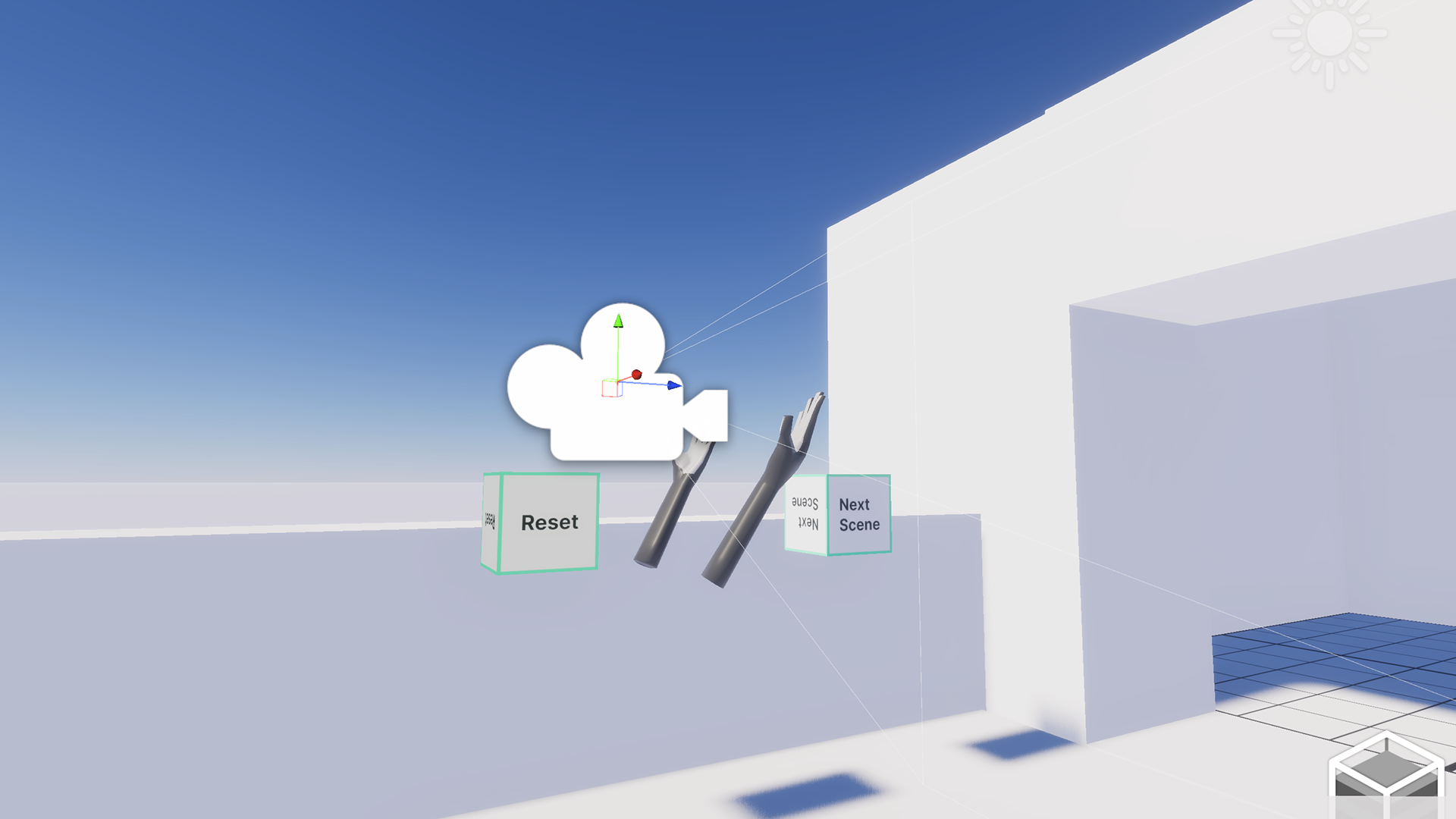

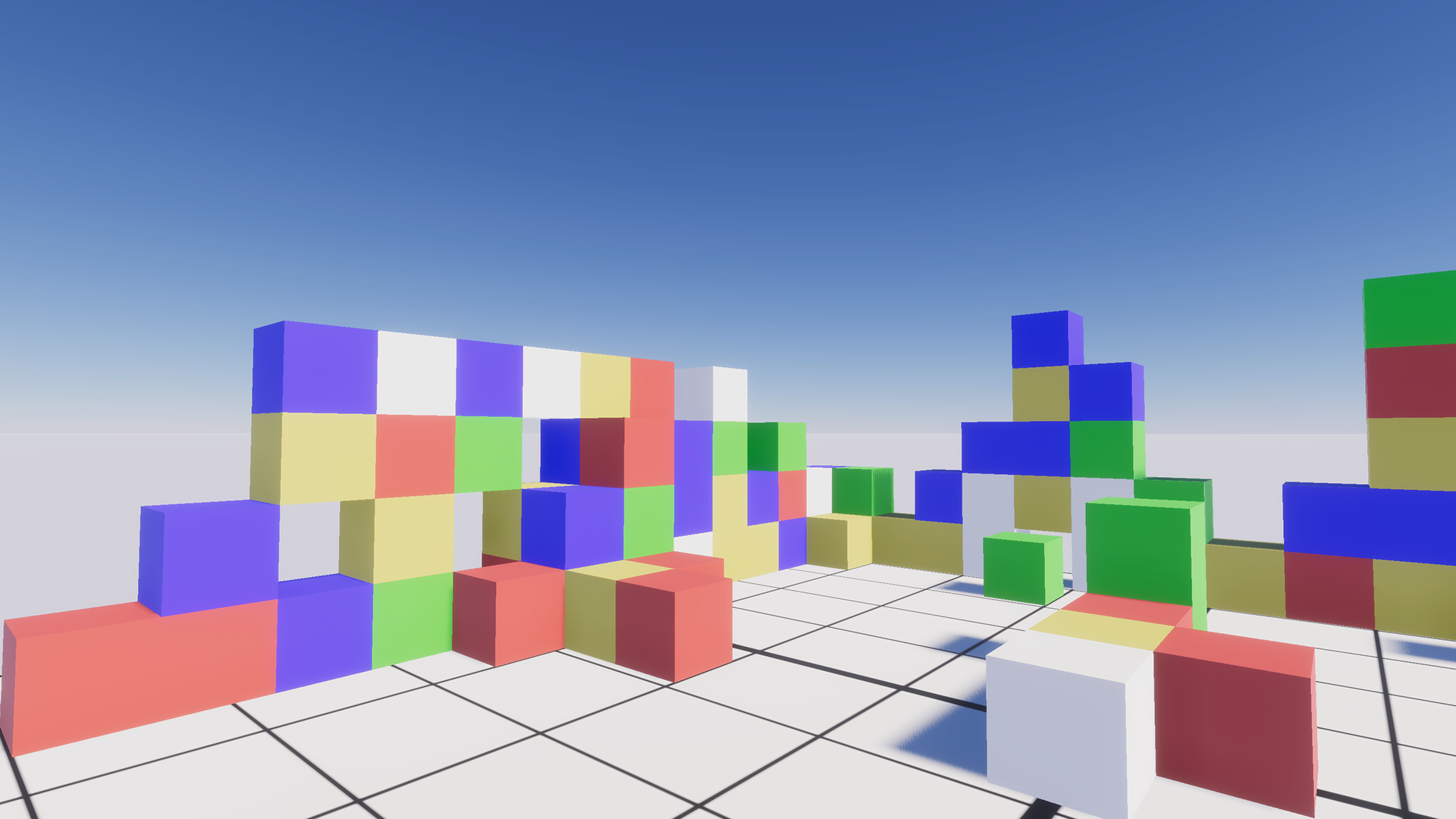

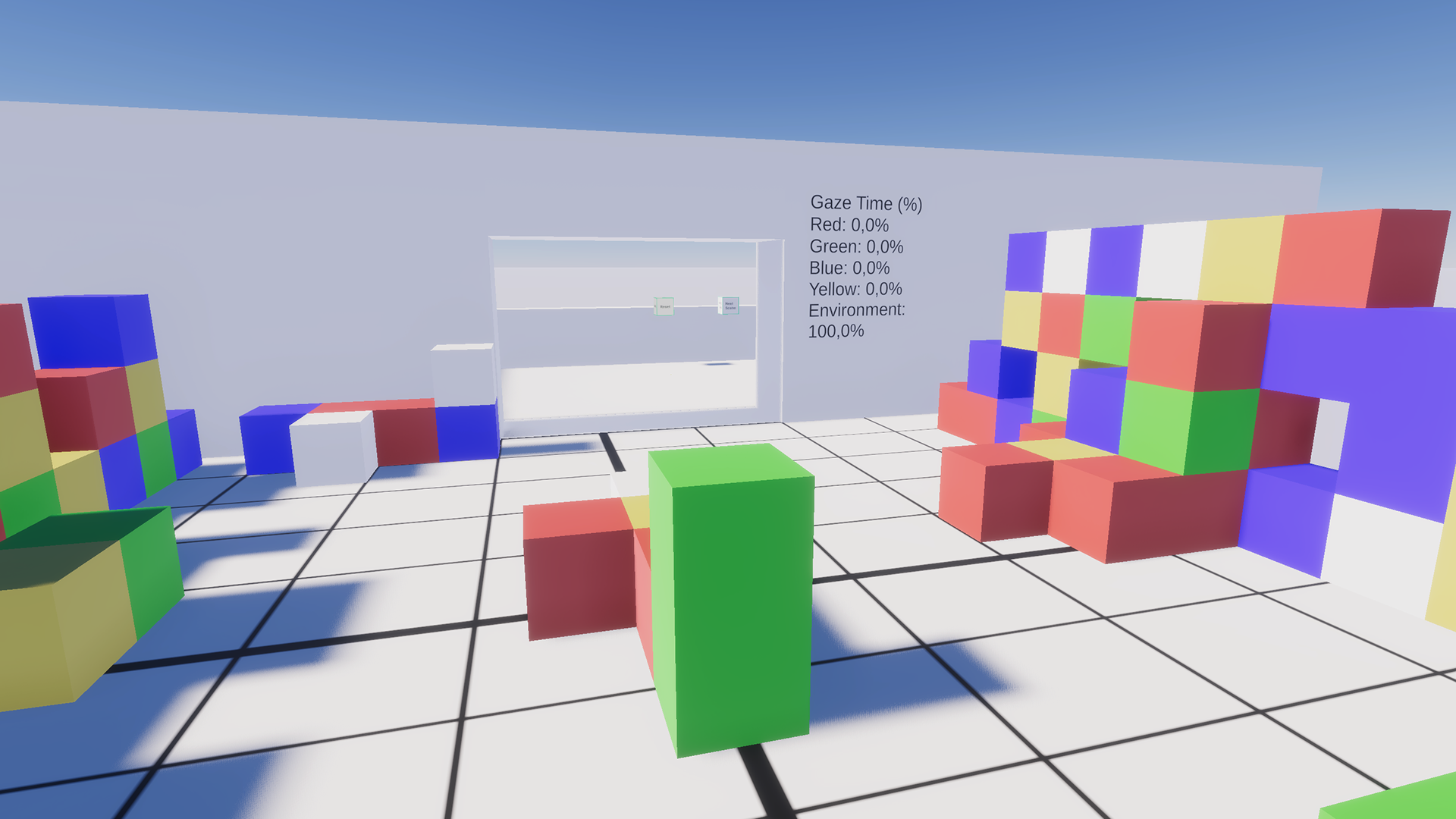

2. Modul: Handtracking und dem Masking-Feature.

In diesem Szenario bewegen sich die Nutzer*innen frei durch die virtuelle Umgebung, wobei die Bewegung allein über die Hände erfolgte (Point & Fly) und somit der Verzicht auf Controller. Über ein Menü kann man die verschiedenen Objekte sichtbar machen oder ausblenden.

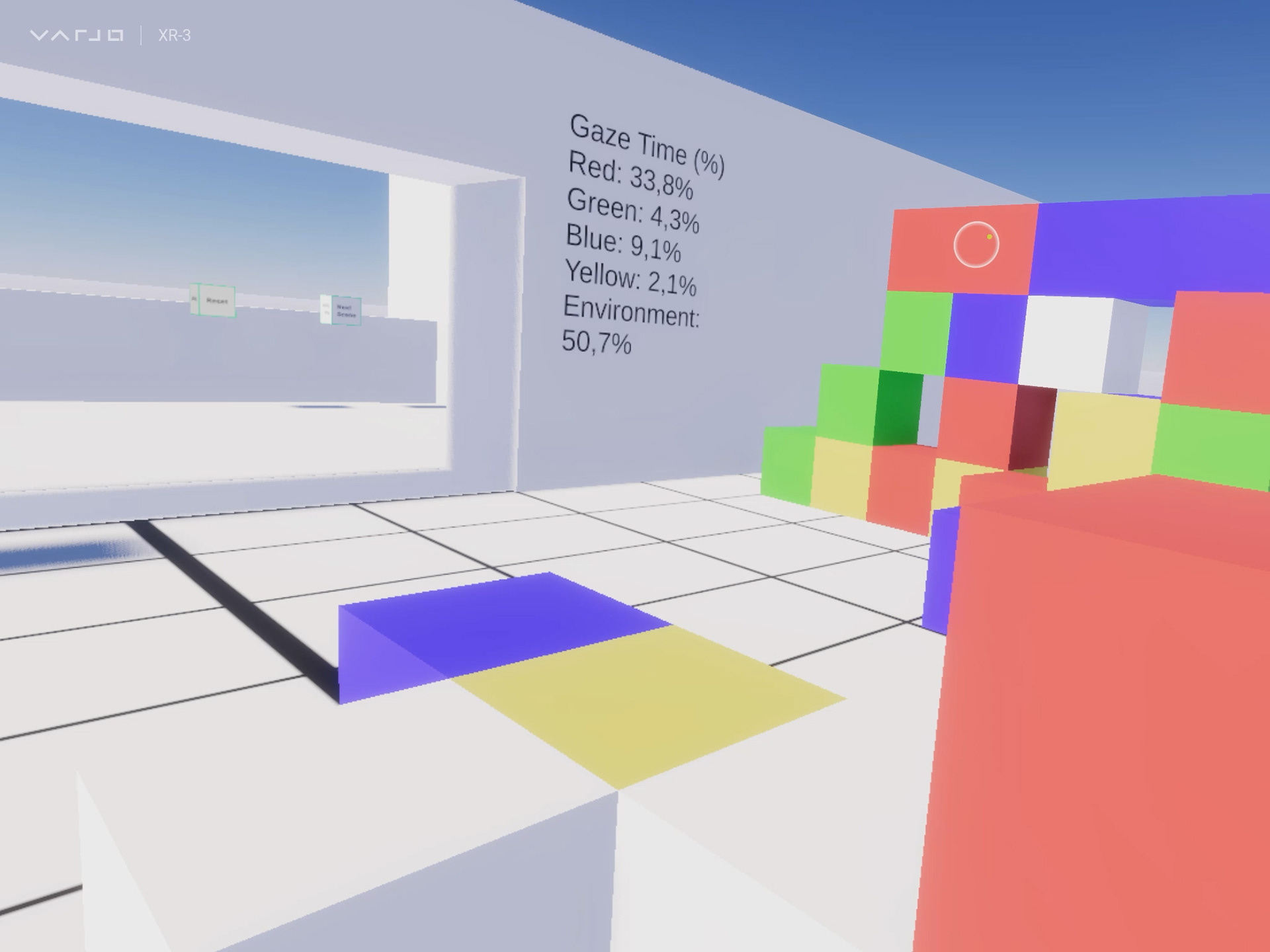

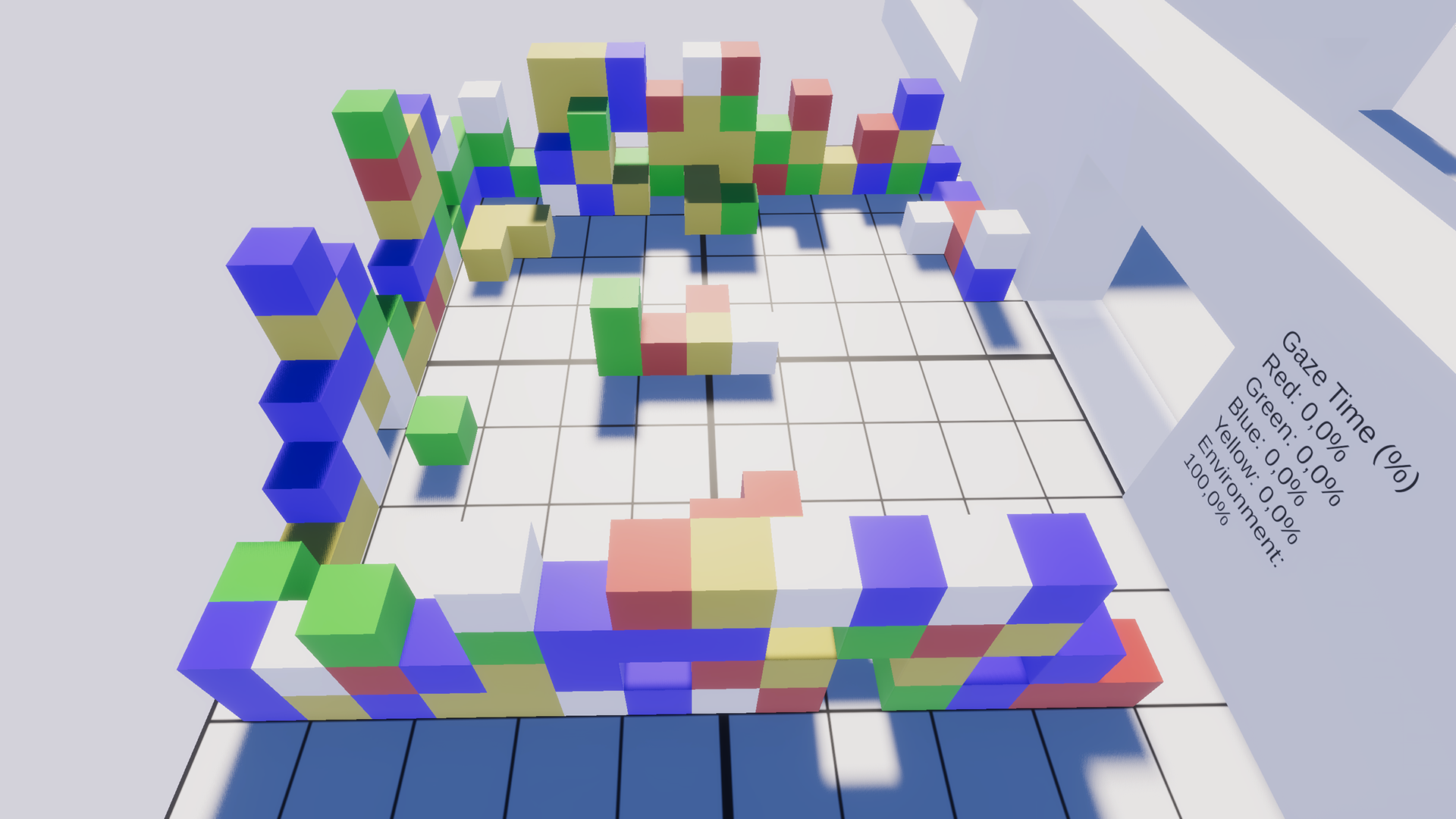

3. Modul: Eyetracking.

Der Nutzende befindet sich in einem virtuellen Demoraum, dessen drei Räume jeweils unterschiedliche Interaktionsszenarien bieten:

Im ersten Raum können Kacheln allein durch ihren Blick zwischen einer virtuellen Darstellung und einem Passthrough-Element umgeschaltet werden.

Im zweiten Raum ist es möglich, Objekte lediglich durch das Fixieren mit den Augen zu bewegen.

Der dritte Raum präsentiert zufällig gefärbte Würfel, die man betrachten kann. Das Blickverhalten wird dann ausgewertet und visuell sichtbar präsentiert. Die Analyse zeigte, welche Farbe am längsten fixiert werden und stellt die Ergebnisse prozentual dar.

Durch die Räume wird nicht nur die Präzision des Eyetrackings sichtbar, sondern auch dessen Potenzial für Anwendungen in den Bereichen Hands-free Interaction, Usability-Analyse, Nutzerforschung und personalisierte Interfaces.

Grundriss AR & Marker basierte Tests

Fraunhofer IAO, 2024

Dieses Projekt war Teil einer internen Forschungsarbeit. Im Fokus stand die Untersuchung markerbasierter Augmented-Reality-Experimente. Dabei habe ich analysiert, welche Arten von Markern besonders zuverlässig erkannt werden – abhängig von Faktoren wie Größe, Farbkontrast, Form und Umgebungslicht.

Alle Versuchsreihen wurden dokumentiert, um Rückschlüsse auf optimale Markerbedingungen ziehen zu können.

Als Ergebnis dieser Forschung entstand eine markerbasierte AR-Anwendung, bei der Grundrisse von Gebäuden als Marker verwendet wurden. Wird ein solcher Grundriss erkannt, erscheinen die zugehörigen 3D-Modelle des Gebäudes und lassen sich interaktiv erkunden.

Als Ergebnis dieser Forschung entstand eine markerbasierte AR-Anwendung, bei der Grundrisse von Gebäuden als Marker verwendet wurden. Wird ein solcher Grundriss erkannt, erscheinen die zugehörigen 3D-Modelle des Gebäudes und lassen sich interaktiv erkunden.

"Wohnraumberatung AR"

Fraunhofer IAO, 2022

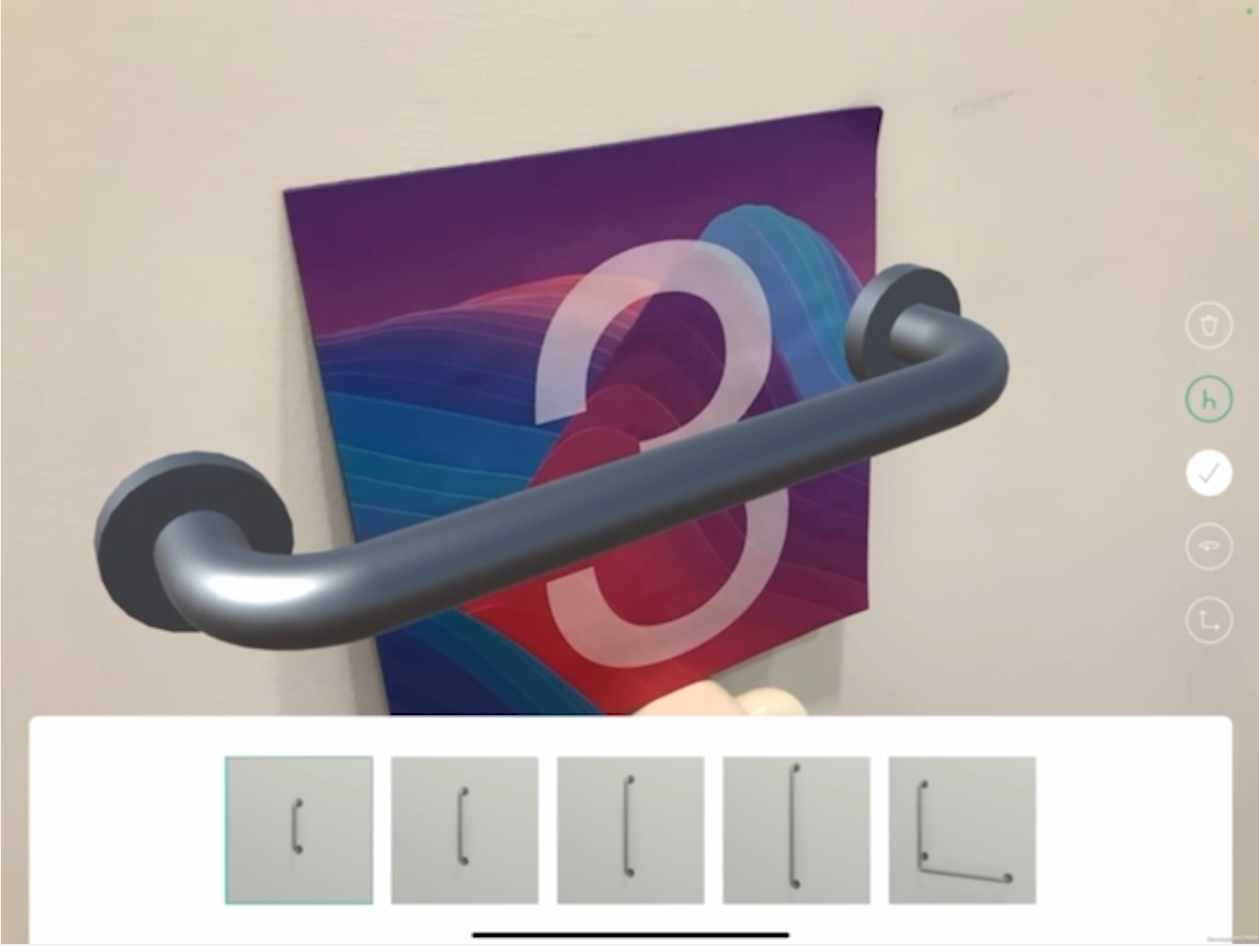

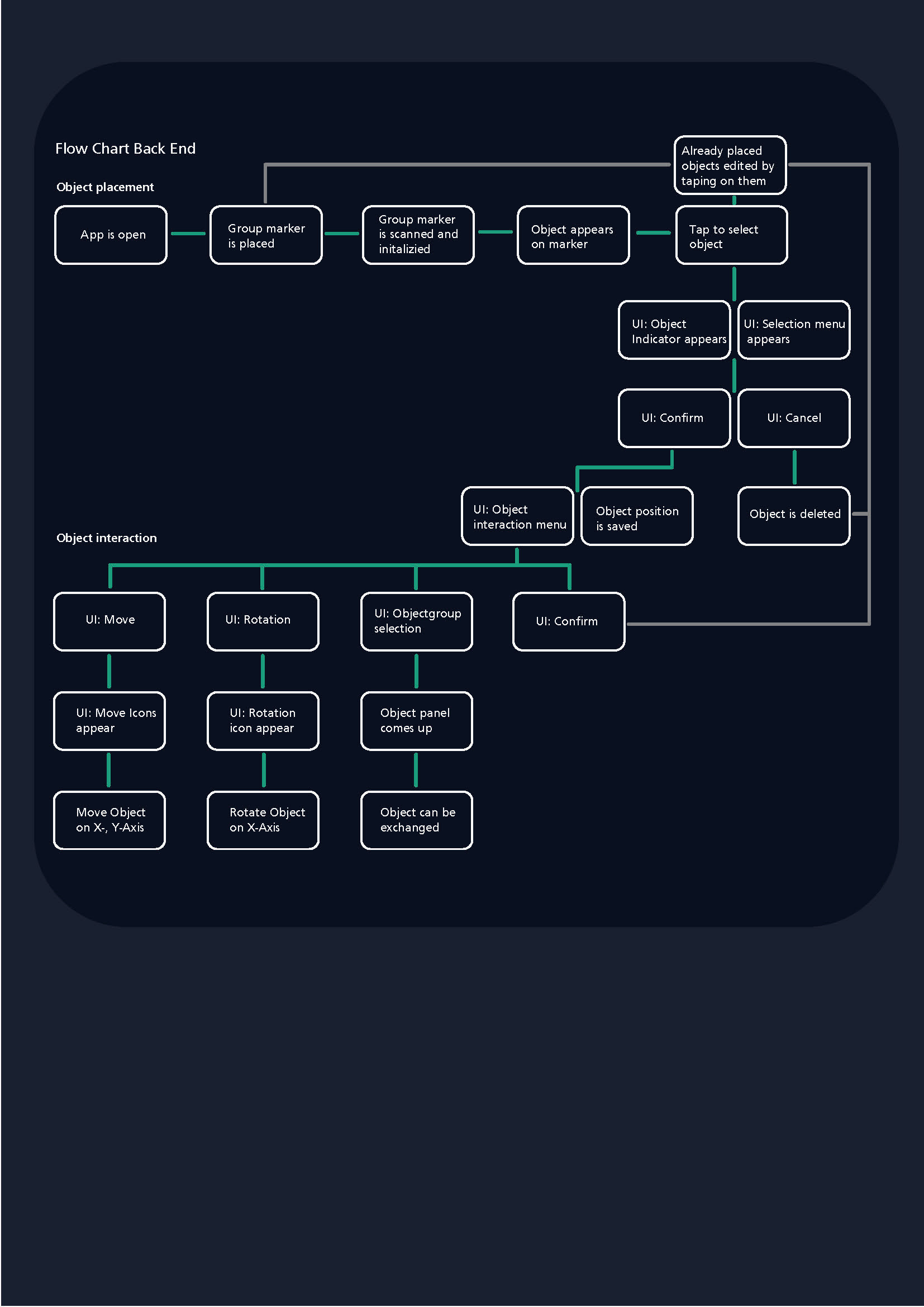

Augmented-Reality-Apps als Entscheidungshilfe in der Wohnberatung. Die Aufgabe des Projekts bestand darin, die Wohnberatungsprozesse mit Augmented Reality zu unterstützen.

Zunächst wurde der Bedarf an Wohnraumanpassungen ermittelt und Ziele sowie Ressourcen miteinander verglichen. Daraus entstand das folgende Konzept für die AR-Wohnraumberatungs-App:

Der Vergleich von Werkzeugen und Möbeln für den Wohnbereich sowie ihrer Varianten sollte erleichtert werden, indem sie mithilfe von AR maßstabsgetreu virtuell im Raum platziert werden.

Zunächst wurde der Bedarf an Wohnraumanpassungen ermittelt und Ziele sowie Ressourcen miteinander verglichen. Daraus entstand das folgende Konzept für die AR-Wohnraumberatungs-App:

Der Vergleich von Werkzeugen und Möbeln für den Wohnbereich sowie ihrer Varianten sollte erleichtert werden, indem sie mithilfe von AR maßstabsgetreu virtuell im Raum platziert werden.

Platziere und scanne Gruppenmarker, um virtuelle Objekte zu platzieren. Positioniere virtuelle Objekte präzise durch Bewegen und Drehen. Anschließend kann zwischen verschiedenen Objekt-Ausführungen innerhalb einer Gruppe gewählt werden.

Ausschnitte aus der Dokumentation.